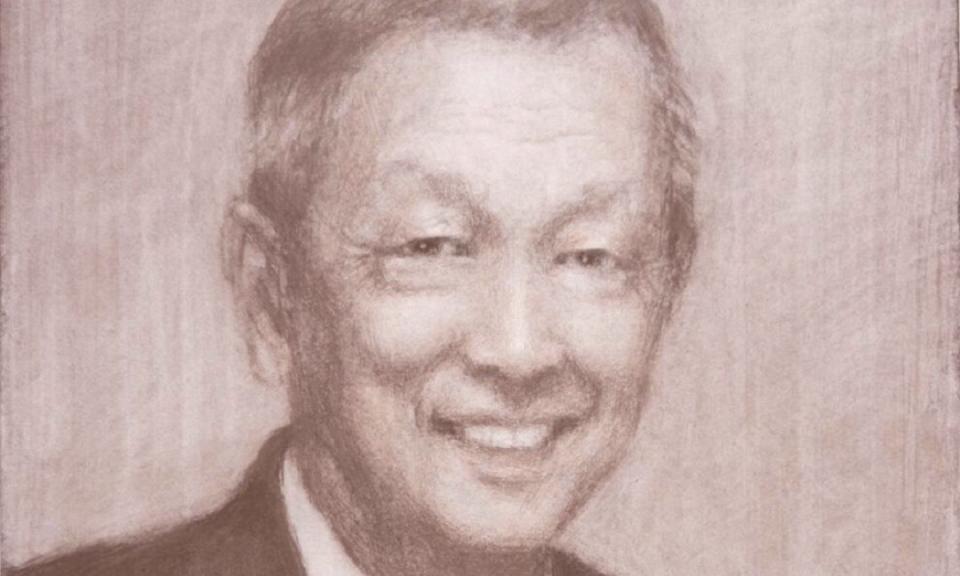

李家同/人工智慧的危險性

我們國家科技一直有「人來瘋」的毛病,最近瘋的是人工智慧(AI),我當然知道AI對人類的貢獻,但是我必須在此很誠懇地警告大家,如果我們濫用AI,AI是很危險的。這從最近波音公司的飛機空難中可以看出。

AI其實是一個程式,任何寫過程式的人都知道程式可能有錯的,學寫程式,也因此要學會偵錯。初期學寫的程式多半是與計算有關的,這種程式的輸入多半是數字,而且非常制式,所以程式偵錯也不難。

程式執行的時候,輸入仍然可能是錯的,比方說,應該輸入的限於數字,但輸入了一些文字,有些程式可以立刻不執行這個程式。如果程式是在計算,即使程式中有錯,算出來的結果不對,通常看結果的人會知道的,不太會造成太大的災害。

可是電腦程式已經不是僅僅在做計算了,程式的輸入變得非常複雜,現在大家在談自動駕駛的汽車,車子當然裝了一個軟體,這個軟體可以知道汽車在行駛中的所有狀況,前方有沒有紅燈,前方以及後方的汽車有多遠,左右有沒有車子,這些資料都要隨時送到汽車的電腦,使它能操縱車子順利前進。

汽車上的電腦如何得到這些資料的?當然依靠車上的感測器。我們可以想見,車上裝了好多的攝影機,這些攝影機所拍攝的影像送到電腦以後,要經過電腦裡的一個影像分析的軟體分析過的,這個軟體一定要在極短的時間內分析送來的影像,而且做出正確的答案。

在學校裡,影像分析的環境是很理想的,光線很充足,方向也合適,所以影像分析也就比較簡單。汽車的攝影機所遇到的環境可說是千變萬化的,行進的路徑可能忽然轉彎,可能起大霧、下雨,這種情形一旦發生,影像分析就可能發生錯誤了。

在美國,曾經發生過自動駕駛的汽車出車禍的事件,事後發現車子前方有嚴重反光的物體,這使得攝影機所拍攝到的影像是失真的,電腦因此做了錯誤的決定。自動駕駛車上的駕駛員是一個非常信任AI的人,他因此完全讓電腦做決定,最後的結果是駕駛員送了命的。

以上的例子,感測器並沒有問題,但是感測器所受到的訊號可能是完全意想不到的。車子行進時忽然碰到大雨,就可能使攝影機根本無法讓電腦知道車子周圍的情況。

更嚴重的是,感測器本身忽然壞了。任何一架儀器都有可能忽然失功能的,如果電腦依賴感測器,當然所做的決定可能有錯了。

AI的核心仍然是一個程式,這個程式本身就可能有錯的,簡單的程式只需要應付制式的輸入,無人汽車的AI程式必須能應付所有可能碰到的狀況,這實在是不可能的。簡單的程式寫好以後,程式測試者還要假想各種不同的輸入,如果程式用在無人汽車上,測試者當然會用盡各種方法來假想可能遇到的情形,但這是很困難的,因為在現實環境中,所有可能發生的狀況實在多到無法事先預料。

我的學生有時會發現程式中有錯,但是程式已被使用了二十年,可見得雖然程式會經過嚴謹的測試,仍然可能有問題的。

因此,我們知道至少有下列三種情況都可能使AI程式出錯:感測器無法應付非常不好而突發的環境、感測器可能壞掉、電腦程式本身就有問題。

任何一個情形發生都可能使AI所做的決定是錯誤的,問題在於,如果AI的程式是輔助性的,那就沒有關係。以汽車來說,駕駛員還是可以做正確的判斷。以飛機來說,飛機的起飛和降落都是由駕駛員操作的,如果空中情況非常正常,自動駕駛是可以的。如果碰到特殊情況,駕駛員要能親自控制飛機,我們看電影就常常會看到這種情況。

這次波音飛機的空難,似乎電腦程式做了決定,駕駛員不能再自己控制飛機了。這種由電腦完全控制飛機的想法是絕對的錯誤,如果真的如此,我們只能責怪飛機設計者沒有智慧。這個世界上的確是有人對科技有絕對的信心,而且這種人相當之多,非常危險也。

我絕對不是反對AI的人,因為任何能夠幫助人做決定的程式都是有意義的。一家煉油公司必須購買不同的油品,油品的種類很多,價格也都不一樣,如何購買某一種油品的組合,幾乎都是靠軟體決定的。我們也可以說這種軟體是AI軟體。這種軟體即使有一點錯,也不會有什麼關係,因為使用者都是有經驗的人,他們還是會做最後決定的。

如果我們迷信AI到如此程度,讓它可以做與人生命有關的決定,而且還不讓專家干預,那就犯大錯了。希望大家能了解這一點。

作者為清華大學榮譽教授

●更多文章見作者臉書,經授權刊載。

●專欄文章,不代表i-Media 愛傳媒立場。

Yahoo奇摩新聞

Yahoo奇摩新聞