「AMD史上最大晶片」炸場CES:1460億電晶體,可大幅壓縮ChatGPT訓練時間

一顆晶片塞進1460億個電晶體。

還號稱能將ChatGPT、DALL·E等大模型的訓練時間,從幾個月縮短到幾週,節省百萬美元電費。

就在科技春晚CES 2023上,蘇媽帶著AMD“迄今為止最大晶片”來炸場子了。

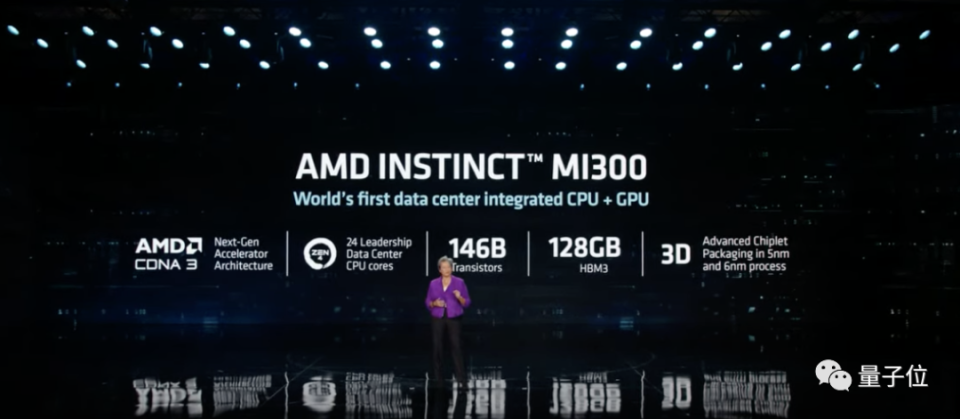

這顆代號為Instinct MI300的晶片,也是AMD首款資料中心/HPC級的APU。

參數性能

1460億個電晶體是個什麼概念?

此前,英特爾的伺服器GPU Ponte Vecchio擁有的電晶體數量是1000億+,而輝達新核彈H100,則整合了800億個電晶體。

不過,熟悉AMD的胖友們都知道,APU簡單來說就是CPU和GPU封裝在了一起。從這個角度上來說,遠超競爭對手的電晶體數量似乎也是情理之中(手動狗頭)。

具體來說,這顆擁有1460億個電晶體的晶片,採用的是小晶片(Chiplet)設計方案。

基於3D堆疊技術,在4塊6nm工藝小晶片之上,堆疊了9塊5nm的計算晶片(CPU+GPU)。

根據AMD公開的資訊,CPU方面採用的是Zen 4架構,包含24核。GPU則採用了AMD的CDNA 3架構。

由於Zen 4架構通常是8核設計,外界普遍猜測,9塊計算晶片中有3塊是CPU,6塊是GPU。

另外,MI300擁有8顆共128GB HBM3視訊記憶體。

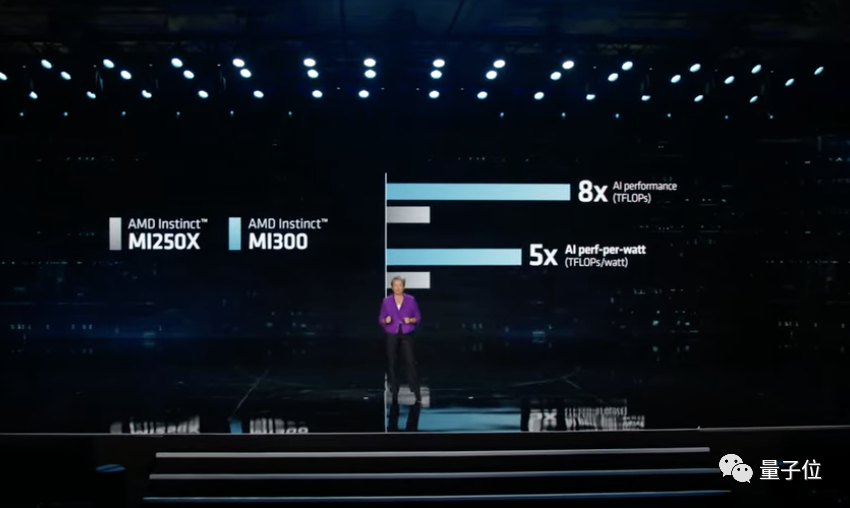

性能方面,AMD並未公佈太多資訊,僅與Instinct MI250X進行了比較。

蘇媽表示,相比於MI250X,MI300每瓦AI性能提升了5倍,AI訓練性能整體提高了8倍。

而據Tom‘s Hardwre消息,AMD還透露,MI300能將ChatGPT、DALL·E等大模型的訓練時間,從幾個月縮短到幾週。

Instinct MI300預計將在2023年下半年交付。屆時,這顆晶片還將被部署到兩台新的百億億次等級(ExaFLOP)超級電腦上。

One More Thing

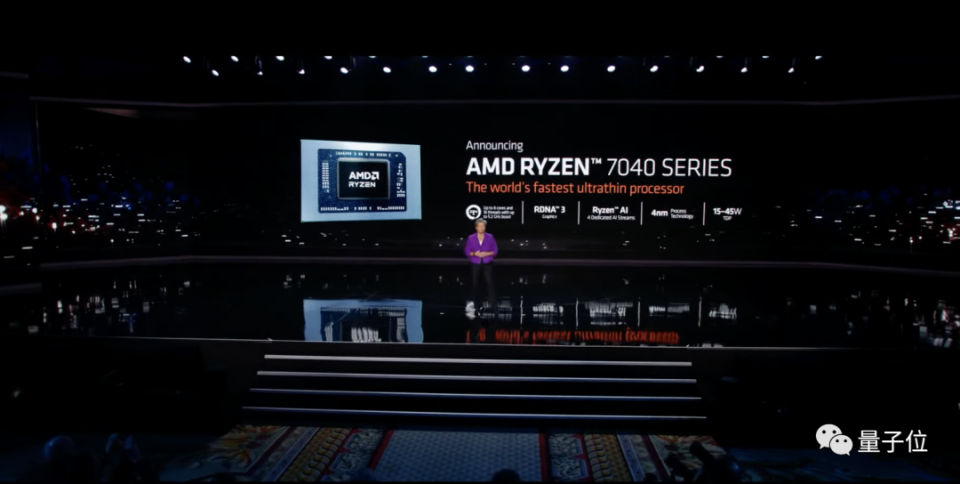

同樣是在今年的CES上,AMD還直接對標蘋果M系列晶片,推出了“世界最快的超薄處理器”——銳龍7040系列。

具體型號包括:Ryzen 5 7640HS、Ryzen 7 7840HS、Ryzen 9 7940HS。

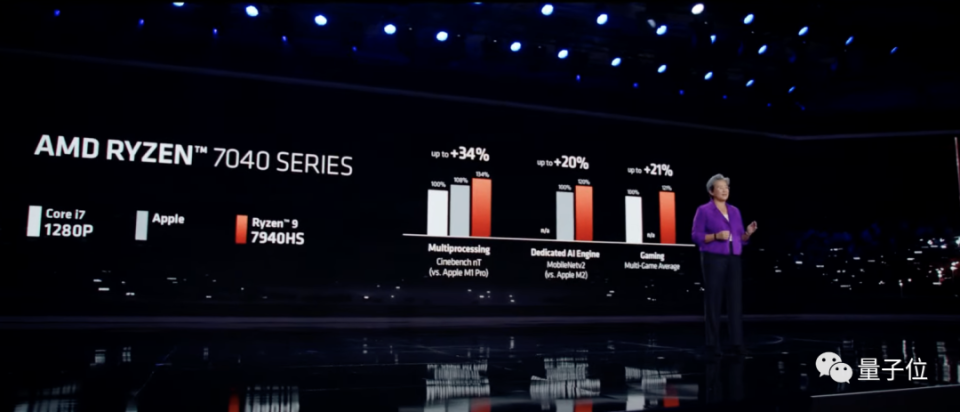

對於其中最高端R9 7940HS,蘇媽大讚說:

R9 7940HS在多執行緒性能方面,比蘋果M1 Pro快34%;在AI任務處理上,比蘋果M2快20%。

還給出了更直觀的體驗資料:搭載銳龍7040系列晶片的超薄筆記本,能連續播放30+小時視頻。

首批搭載銳龍7040處理器的筆記型電腦,將在今年3月份出貨。

不管怎麼說,這消息可把吃瓜群眾樂壞了:

蘋果下場自研PC晶片,加強了晶片製造商之間的競爭,這種局面其實10年前就該有了。

參考連結

[1]https://www.youtube.com/watch?v=OMxU4BDIm4M

[2]https://www.tomshardware.com/news/amd-instinct-mi300-data-center-apu-pictured-up-close-15-chiplets-146-billion-transistors

[3]https://www.anandtech.com/show/18721/ces-2023-amd-instinct-mi300-data-center-apu-silicon-in-hand-146b-transistors-shipping-h223

[4] https://www.macrumors.com/2023/01/05/amd-new-chips-against-m1-pro/

本文來自微信公眾號“量子位”(ID:QbitAI),作者:魚羊 Alex,36氪經授權發佈。

本文經授權發布,不代表36氪立場。

如若轉載請註明出處。來源出處:36氪

Yahoo奇摩新聞

Yahoo奇摩新聞