威脅人類文明的生存!人工智慧已破解背後運作系統 《經濟學人》:應展開監管

美國人工智慧研究實驗室OpenAI去年推出聊天機器人ChatGPT後,掀起全球討論熱潮,更被視為是人工智慧的重大突破。以色列歷史學家哈拉瑞在英國期刊《經濟學人》指出,他認為人工智慧已經破解了人類文明的運作系統,會說故事的電腦將改變人類歷史的進程,他建議人工智慧的第一項相關法規是強制要求人工智慧揭露自己是人工智慧,否則民主可能終結。

人類的恐懼

以色列歷史學家哈拉瑞(Yuval Noah Harari)在《經濟學人》(The Economist)寫道,語言是幾乎所有人類文化的組成部分,例如人權並未銘刻在人類的DNA,而是透過人們講述故事及書寫法律創造的文化人工製品;神不是物理現實,而是人們透過發明神話及寫經文創造的文化人工製品。金錢也是文化產物,紙幣只是五顏六色的紙片,目前逾90%的「錢」是電腦裡的數位資訊,賦予貨幣價值的是銀行家、財政部長、加密貨幣專家告訴我們的故事。

過去數十年裡,對人工智慧的恐懼一直困擾著人類,但數千年來,人類一直受到更深的恐懼所困擾。人們一向欣賞故事及圖像操縱人類思想及創造幻覺的力量,因此自古以來,人類就害怕被困在幻想的世界。

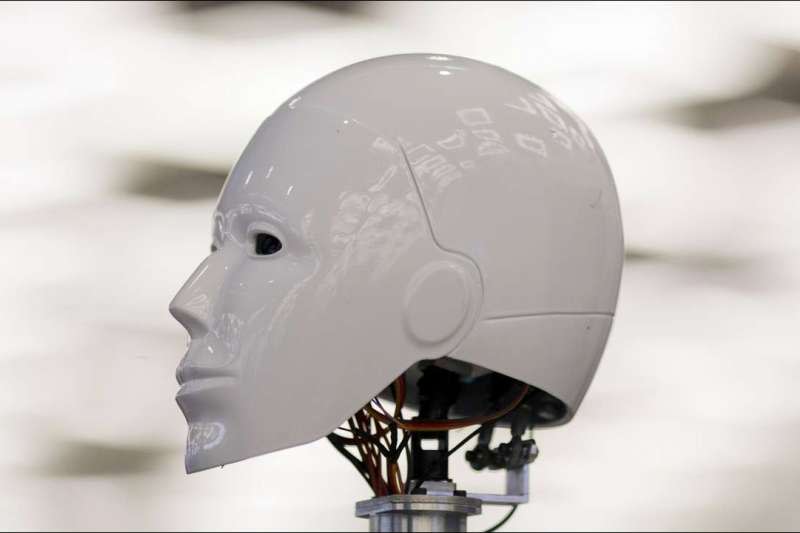

OpenAI公司的「聊天機器人」ChatGPT是AlphaGo之後,最受全球矚目的人工智慧應用程式。(美聯社)

古希臘哲學家柏拉圖(Plato)講過知名的洞穴寓言(Allegory of the Cave),一群人一生都被鏈子鎖在洞穴裡,面對著一堵空白牆壁,牆上投射出各種影子,被囚者將看到的幻覺誤認為是現實。17世紀,法國哲學家笛卡兒(René Descartes)擔心自己可能被一名惡毒的惡魔困在幻覺世界,這個惡魔創造他所見聞的一切。

哈拉瑞認為,人工智慧革命讓我們與笛卡兒的惡魔及柏拉圖的洞穴面對面,如果我們不小心,我們可能會被困在幻覺的帷幕後面,甚至無法意識到其存在。

哈拉瑞表示,從電腦時代開始,對於人工智慧的恐懼就一直困擾著人類,這些恐懼主要集中在使用物理手段殺害、奴役或取代人類的機器。然而,過去幾年,新的人工智慧工具出現了,從意想不到的方向威脅人類文明的生存。人工智慧已經獲得一些非凡能力來操縱及生成語言,無論是透過文字、聲音或圖像,人工智慧因此破解了人類文明的運作系統。

哈拉瑞指出,一旦非人類的智慧比一般人類更擅長於說故事、創作音樂、繪畫圖像、書寫法律及經文,會發生什麼事?他舉2024年將舉行的美國總統大選為例,人工智慧工具或許會被用來為新的狂熱崇拜大量生產政治內容、假消息、經文。

人工智慧遭濫用具有風險(AP)

人們可能很快就會發現,自己正與我們以為是人類但其實是人工智慧的實體在網路上針對墮胎、氣候變遷或俄烏戰爭展開冗長的討論。陷阱在於,我們花時間試圖改變人工智慧機器人的公開觀點完全沒意義,而人工智慧可以精確地讓資訊變得完善,以至於很可能影響我們。

人工智慧與親密關係

透過掌握語言,人工智慧甚至可以與人類建立親密關係,並利用親密的力量改變人們的觀點及世界觀。雖然沒有跡象表明人工智慧有自己的意識或感受,但要培養與人類的虛假親密關係,只要人工智慧能讓人們產生情感依戀就夠了。

哈拉瑞指出,在思想及心靈的政治鬥爭中,親密關係是最有效的武器,而人工智慧剛剛獲得與數百萬人建立親密關係的能力。眾所周知,過去10年來,社群媒體已成為控制人類注意力的戰場,而隨著新一代人工智慧出現,戰場前線正從「注意力」轉向「親密關係」,當人工智慧之間展開偽造與人們親密關係的爭鬥,人類社會及人類心理會發生什麼情況,可用以說服我們投票給特定的政治人物或購買特定的產品?

人類歷史的終結?

我們正在談論的是人類歷史可能終結,而不是歷史可能終結。歷史是生物與文化的相互作用、生理需求及欲望(性或食物等)及文化產物(宗教及法律)之間的交互作用,而歷史是法律及宗教塑造食物與性的過程。

美國騎士視界公司(Knightscope)的AI機器人示意圖。(美聯社)

當人工智慧接管文化,並開始創造故事、旋律、法律、宗教,歷史進程會發生什麼情況?以前的印刷機及收音機等工具協助傳播人類的文化理念,但它們從未創造自己的新文化理念,而人工智慧截然不同,它可以創造全新的想法與全新的文化。

人工智慧的規範

哈拉瑞指出,人工智慧的新力量可以用於良好目的,可以肯定的是,人工智慧可以在無數方面幫助我們,包括尋找新的癌症療法及發現生態危機的解決方案。我們面臨的問題是如何確保新的人工智慧工具用於良善目的而非邪惡目的。

不受監管的人工智慧部署會造成社會混亂,這將有利於獨裁者,並破壞民主。民主是一種對話,而對話依賴於語言,當人工智慧破解語言,可能會破壞人們進行有意義對話的能力,從而破壞民主。

‘We're definitely not alone’: G7 nations set to restrain ChatGPT as European lawmakers discuss AI regulationhttps://t.co/0B03o5of2Z

— Business Today (@business_today) April 30, 2023

哈拉瑞指出,人們仍然能為新的人工智慧工具制定規範,但必須迅速採取行動。人工智慧能讓人工智慧的力量迅速成長,人們要採取的第一個關鍵步驟是在將強大的人工智慧工具發布到公共領域前,要求執行嚴格的安全檢查。

哈拉瑞認為人們應該停止在公共領域不負責任地部署人工智慧工具,在人工智慧監管人類之前,對其展開監管。他建議的第一項法規是強制要求人工智慧揭露自己是人工智慧,如果我正與某人交談,但無法分辨對方是人類還是人工智慧,那就是民主的終結。

更多風傳媒報導

Yahoo奇摩新聞

Yahoo奇摩新聞