FSD造假實錘,特斯拉技術大牛法庭證實:官方宣傳視訊造假,緊急接管意外撞車都被剪掉了

特斯拉多事之秋。

自動駕駛宣傳視訊造假,被自家工程師向法庭證實,而且是現任自動駕駛軟體總監。

他說,至今還掛在特斯拉官網的FSD自動駕駛宣傳視訊,實際上是“擺拍”。

不但是提前做足準備的“開卷考試”,而且拍攝時自動駕駛還撞了…

即使這樣,馬斯克依然強推這則所謂“完全自動駕駛”宣傳材料。

而當年一樁特斯拉動駕駛致命事故再度被熱議。

特斯拉視訊怎麼造假了?

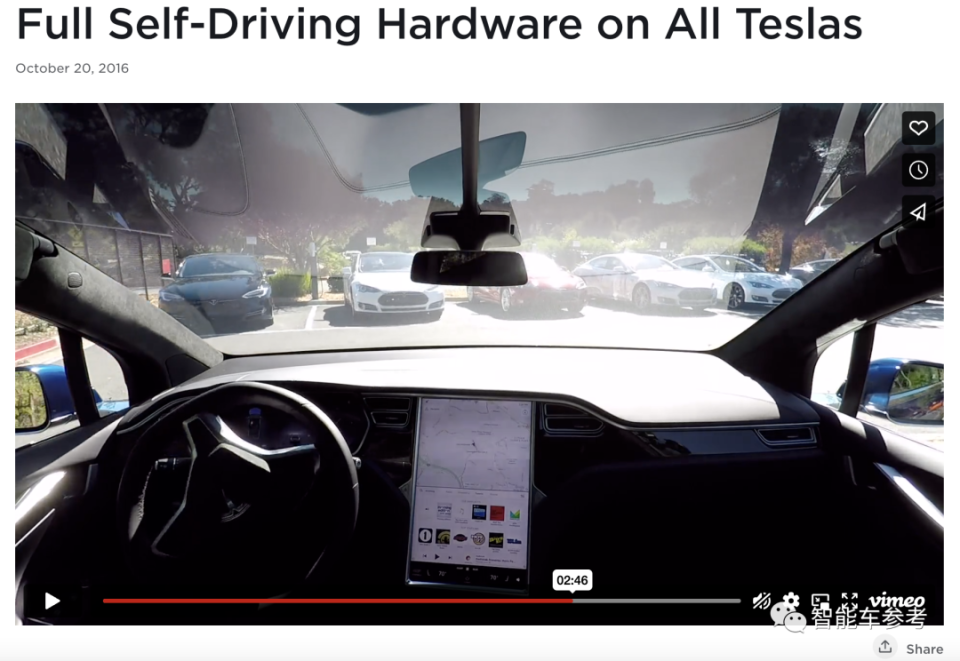

這則視訊至今仍然掛在特斯拉官網上,並且標題赫然寫著:

時間是2016年,FSD還沒被定為產品名,但“full self-driving”的說法已經開始使用。

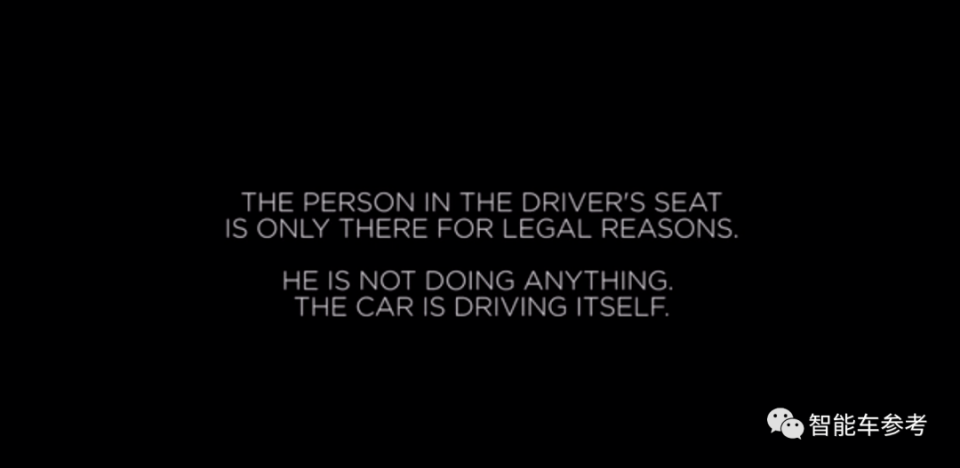

視訊一開頭車還沒出場,黑底白字正告:“視訊中駕駛員僅因為法規要求坐在駕駛位,他全程沒有操作汽車,特斯拉自己駕駛自己”。

展示的功能,包括高速場景下的自動駕駛:

在泊車場景下,並非記憶泊車,而是駕駛員直接下車,由車輛自己在停車場內穿梭尋找空餘車位,既考驗車端演算法的感知決策能力,還考驗系統對場景的即時3D建構能力,屬於更加高階的自主泊車技術:

另外,無論在城市還是高速行駛過程中,一個重要的特徵是Autopilot除了根據感測器資料即時決策,還能根據導航資訊規劃總路線:

特斯拉展示的這套功能或者說系統,其實就是現在常說的“三域融通”高階自動駕駛,即包括泊車、高速、城市道路在內。

這也是目前幾乎所有智能駕駛量產玩家正在追逐競賽的目標。

彼時2016年,特斯拉就說自己已經具備了這樣的能力。

但特斯拉自動駕駛軟體總監給法庭的證詞中,卻揭穿了視訊背後的“真相”。

首先,從加州Menlo Park的一所私人住宅到Palo Alto特斯拉加州總部的路線全程,早就做好環境建模,存在了系統中。

也就是說,整場測試其實是“開卷”考試,Autopilot系統知道自己要走什麼樣的路線、怎麼走。

所以第一個能明確的點是,所謂“領航”功能是存疑的。

其次,在給整條線路建模的過程中,路上關鍵的資訊,可能已經被標註了出來。包括交通標誌、紅綠燈、大曲率彎道、路上的坑窪施工等等情況。

這樣一來,整個系統通過感測器資料感知識別別並決策的能力,也就是我們常說的自動駕駛AI演算法的核心能力,至少在2016年時也是存疑的。

事實上,這位工程師坦白,整個測試過程司機有過緊急干預接管,只不過後來做視訊時剪掉了。視訊開頭黑底白字“司機全程沒有駕駛”,假的。

最後,泊車場景,特斯拉自動駕駛軟體總監直接實話實說,拍攝時車子撞了,撞到了特斯拉總部停車場的護欄…

但是,他說拍視訊展示“特斯拉完全自動駕駛能力”是馬斯克親自佈置的任務,所以最後通過各種手段和辦法,拿出了這樣的結果。

從視訊中看不出任何破綻,“完全自動駕駛”被著重強調,拍攝期間各種證明系統能力尚不足的事實情況,隻字不提。

最後,視訊上線直到今天,都是特斯拉宣傳其技術能力和自動駕駛前景的重要材料。

馬斯克轉發時,興奮地加以說明:

特斯拉開著它自己,從城市到高速直至找到停車位!

不過,這位給法庭提供證詞的特斯拉工程師也進行了辯護。他認為當時拍這個視訊,並非向使用者承諾2016年交付的功能,而是展示特斯拉在未來研發中會給車輛搭載什麼樣的功能。

從特斯拉宣傳的措辭上看,從來沒有明說這些功能就是使用者馬上能買到的。“Full self-driving hardware on all Teslas”沒有時態要素,所以既可以理解成對現在狀態的描述,也可以理解成對未來的展望。

而且人家加上了hardware,真要被追究,可以說當時只侷限在硬體。

特斯拉、馬斯克玩得一手好文字遊戲,很聰明。

但對於使用者來說,這樣的宣傳確有誤導之嫌。所以在特斯拉工程師揭穿“擺拍”視訊後,當年的一起特斯拉自動駕駛致命事故,又被熱議關注。

馬斯克:向死者家屬致以慰問哀悼

特斯拉工程師的證詞,其實就是這起案件的後續。

2018年,一位華人蘋果工程師,駕駛著視訊同款Model X,在使用Autopilot時完全信任了系統,自己走了神,結果車子撞向了高速中央隔離帶,車毀人亡。

事故發生後,遇難者家屬將特斯拉告上法庭,認為特斯拉存在產品設計缺陷、未發出警告、違反保證、故意和疏忽的虛假陳述以及虛假廣告。

遇難者家屬還說曾多次就Autopilot問題向經銷商投訴抱怨,但一直無果。

特斯拉的回應是這樣:

他知道當時場景AP不適用,但他仍然啟用了。事故發生在晴天,前方能見度為數百英呎,這意味著發生這起事故的唯一可能是沒有注意道路,儘管汽車多次發出警告。

“使用者使用不當,未及時接管,自動駕駛沒有錯”。

事故發生以後,特斯拉和馬斯克本人都第一時間表達了對遇難者家屬的慰問哀悼,並沒有取得諒解。

官司進行的這幾年中,特斯拉“完全自動駕駛”的宣傳策略,遭遇多方質疑。在德國,法院直接禁止特斯拉這樣宣傳。

現在在向車主交付車輛的過程中,特斯拉也更小心謹慎,強呼叫戶一定要時刻集中注意力,隨時準備接管車輛。

只不過,這則視訊至今仍然掛在特斯拉官網上。特斯拉也從2018年起,定期公佈安全報告,證明與傳統汽車相比,特斯拉安全性有質的飛躍。

但是最新的供詞,已經證實拍Demo時已經撞車了,遠達不到可靠程度,官網宣傳還說堅持說完全自動駕駛…

造假的視訊,被誰揭發?

最後說兩句這個站出來實錘特斯拉宣傳造假的工程師。

Ashok Elluswamy,印度裔,特斯拉現任自動駕駛軟體總監。2014年就加入特斯拉,從Autopilot基層工程師一路幹到總監職位。現在領導整個自動駕駛軟體研發團隊。

之前的幾次特斯拉AI Day,都有他的身影。

說他“反水”特斯拉,其實不太準確。更主要的原因,是因為他沒法向法庭撒謊,否則會有更嚴重的針對他個人的指控。

而且,他在供詞中,也的確為特斯拉辯護了。

這個官司還在打,Ashok Elluswamy的供詞也是最新向法庭呈交的。但這份供詞本身,可能成一個關鍵轉折,因為它坐實了特斯拉在宣傳視訊中造假。

接下來控辯雙方爭奪的焦點,轉移到特斯拉的“免責”是否有效。比如遇難者當時有沒有用作弊手段騙過駕駛員監控系統,以及特斯拉的文字遊戲,法庭是否買賬。

One more thing

明知技術不成熟,系統有風險,還可能給自己惹上官司,馬斯克為什麼還執意宣傳“全自動駕駛”?

紐約時報一篇萬字長文,採訪了大量特斯拉事故受害者、擁護特斯拉的粉絲、心理學家,以及和馬斯克接觸過的人,深挖了他這麼做的底層邏輯。

NYT的結論是:

“馬斯克是一個徹底的長期主義者、功利主義者,不知風險為何物,也沒有嚴格的道德規則。”

特斯拉宣傳視訊頁面

https://www.tesla.com/videos/full-self-driving-hardware-all-tesla-cars

NYT長文《馬斯克的毀滅欲》

https://www.nytimes.com/2023/01/17/magazine/tesla-autopilot-self-driving-elon-musk.html?auth=login-google1tap&login=google1tap

工程師證實特斯拉宣傳造假

https://www.reuters.com/technology/tesla-video-promoting-self-driving-was-staged-engineer-testifies-2023-01-17/

本文來自微信公眾號“智能車參考”(ID:AI4Auto),作者:賈浩楠,36氪經授權發佈。

本文經授權發布,不代表36氪立場。

如若轉載請註明出處。來源出處:36氪

Yahoo奇摩新聞

Yahoo奇摩新聞